结合植被光谱特征与Sep-UNet的城市植被信息智能提取方法

|

林 娜(1981— ),女,湖北襄阳人,博士,副教授,主要从事遥感影像智能处理等方面的研究。E-mail: linnawb@126.com |

收稿日期: 2022-11-07

修回日期: 2023-03-28

网络出版日期: 2023-07-14

基金资助

国家重点研发计划项目(2021YFB2600600)

国家重点研发计划项目(21YFB2600603)

教育部产学合作协同育人项目(220702313111054)

重庆市技术创新与应用发展专项重点项目(CSTB2022TIAD-CUX0016)

宁夏回族自治区重点研发计划(2022CMG02014)

Intelligent Extraction of Urban Vegetation Information based on Vegetation Spectral Signature and Sep-UNet

Received date: 2022-11-07

Revised date: 2023-03-28

Online published: 2023-07-14

Supported by

National Key Research and Development Program of China(2021YFB2600600)

National Key Research and Development Program of China(21YFB2600603)

Industry-University Cooperation Education Program of Ministry of Education(220702313111054)

Chongqing Technology Innovation and Application Development (Key Industry Research and Development)(CSTB2022TIAD-CUX0016)

Key R&D Program of Ningxia Hui Autonomous Region(2022CMG02014)

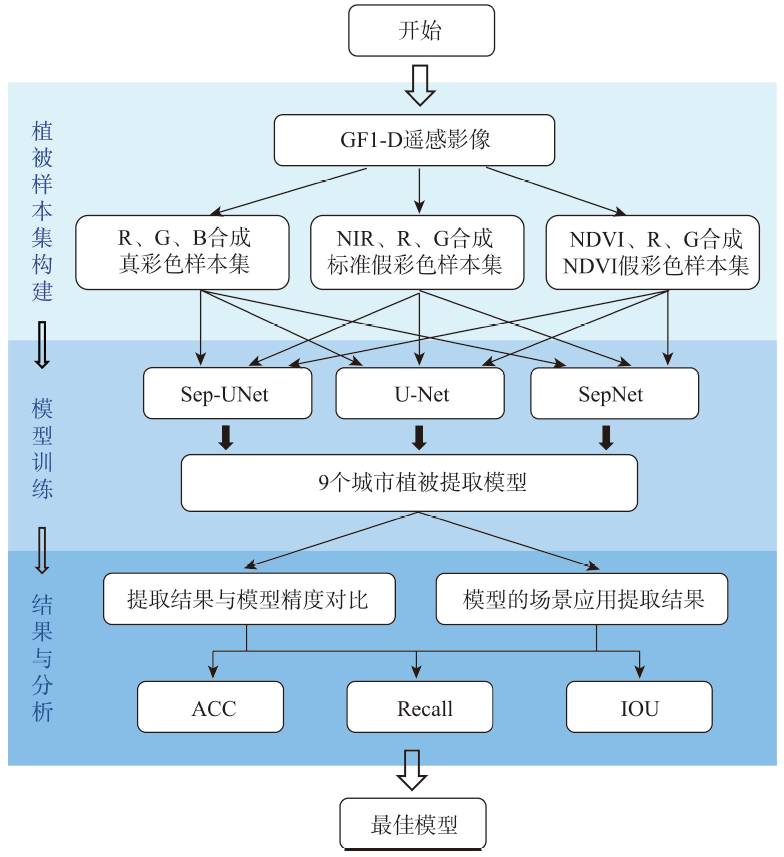

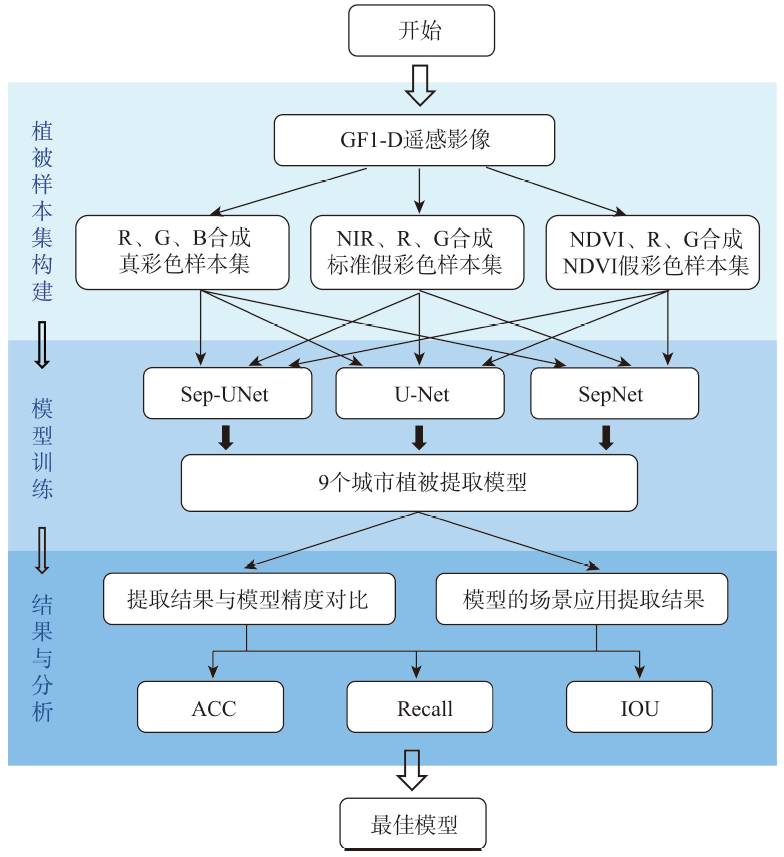

城市植被在城市环境中起着举足轻重的作用,高效、准确的城市被信息提取是目前亟需解决的任务之一。针对研究中U-Net网络存在的深度较浅使得植被细节特征遗漏,小数量植被样本造成网络拟合表现不佳以及大量参数导致的网络运算负担过重等问题,本文在U-Net网络的基础上,利用可分离卷积、批量标准化层、Tanh激活函数,设计提出了一种Sep-UNet网络。基于GF-1D高分遥感影像,结合Sep-UNet与植被在近红外波段上最具标志性的光谱反射特性,进行了高分遥感影像城市植被信息提取的研究。结果表明:① 标准假彩色样本集的植被提取模型精度最佳,NDVI样本集次之,真彩色波段的最差;② Sep-UNet在验证样本集中提取城市植被信息的各项精度指标(ACC:0.9576,IOU:0.8938,Recall:0.9549)均优于U-Net(ACC:0.9389,IOU:0.7593,Recall:0.9405),且明显优于SegNet (ACC:0.8897,IOU:0.8019,Recall:0.8867),这表明本文做出的网络优化有利于城市植被信息的提取并取得了更好的精度;③ Sep-UNet模型在公园、建筑、云雾、城郊场景的植被提取结果表示,模型在验证样本集之外的影像上同样能够很好地执行城市植被信息的提取,近红外波段的引入也使得Sep-UNet模型具备更好的迁移性和泛化性。

林娜 , 何静 , 王斌 , 唐菲菲 , 周俊宇 , 郭江 . 结合植被光谱特征与Sep-UNet的城市植被信息智能提取方法[J]. 地球信息科学学报, 2023 , 25(8) : 1717 -1729 . DOI: 10.12082/dqxxkx.2023.220866

Urban vegetation is an important component of urban ecosystems and plays a vital role in human settlements, urban ecology, urban planning, and sustainable development. It is urgent to develop an efficient and accurate method to achieve the intelligent extraction of urban vegetation. In view of the problems of low efficiency and strong human intervention in the extraction of urban vegetation by traditional methods, and insufficient utilization of spectral information in deep learning methods, this study focused on intelligent extraction of urban vegetation from GF-1D high resolution remote sensing images by combining the most important spectral reflection characteristics of vegetation in the Near Infrared (NIR) band and the Sep U-Net, an optimization of U-Net. The main work of this research includes: (1) we created three sample sets considering the high reflectance of vegetation in the NIR band: the true-color green space sample set (true sample set), which served as the control group, the standard false-color green space sample set (the fake sample set), and the false-color green space sample set synthesized by NDVI (NDVI sample set); (2) the Sep-UNet was optimized based on U-Net. On the basis of U-Net, Sep-UNet expanded the network receptive field and increased the network depth by increasing the number of concatenated convolutions to achieve the purpose of enhancing the network's information processing of vegetation details. The separable convolution was used to reduce the network parameters while maintaining the underlying characteristics and depth of the network, avoiding the computational burden caused by network deepening. The batch normalization layer and Tanh activation function were also used to enhance the operability and robustness of the network; (3) we extracted urban vegetation from multiple scene images. Four typical urban scenes were selected from remote sensing images outside the sample set, and models were applied to extract urban vegetation from scene images with typical urban characteristics to verify the applicability and transferability of the models. The results show that: (1) The inclusion of NIR band significantly enhanced the accuracy of urban vegetation extraction. The extraction results using standard false color sample set were the best, followed by NDVI sample set, and the extraction results using true color sample set were the worst; (2) Based on the validation sample set, the urban vegetation extraction accuracy using Sep-UNet (ACC: 0.9576, IOU: 0.8938, Recall: 0.9549) was better than that using U-Net (ACC: 0.9389, IOU: 0.7593, Recall: 0.9405), and much better than that using SegNet (ACC: 0.8897, IOU: 0.8019, Recall: 0.8867), which demonstrated that the proposed model in this paper obtained best results for extraction of urban vegetation; (3) The extraction results from multiple scene images based on Sep-UNet showed that the model can also extract urban vegetation well from images beyond the sampling area, and the inclusion of NIR band can eliminate the interference of thin clouds, mist, and buildings, making the model have good generalizability.

表1 U-Net与Sep-UNet参数对比Tab. 1 Parameter comparison between U-Net and Sep-UNet |

| 网络模型 | 下采样卷积层数/个 | 网络参数总数量/个 |

|---|---|---|

| U-Net | 10 | 31 379 010 |

| Sep-UNet | 15 | 18 890 626 |

表2 验证样本集城市植被信息提取结果Tab. 2 The urban vegetation information extraction results of validation sample set |

| 方法 | Fake样本集 | NDVI样本集 | True样本集 | |||||||

|---|---|---|---|---|---|---|---|---|---|---|

| 区块1 | 区块2 | 区块1 | 区块2 | 区块1 | 区块2 | |||||

| 原始影像 |  |  |  |  |  |  | ||||

| 标签 |  |  |  |  |  |  | ||||

| SegNet |  |  |  |  |  |  | ||||

| U-Net |  |  |  |  |  |  | ||||

| Sep-UNet |  |  |  |  |  |  | ||||

注:白色区域为植被区域,黑色为非植被区域。 |

表3 模型精度对比Tab. 3 The comparison of model accuracy |

| 网络模型 | Fake | NDVI | True | ||||||||

|---|---|---|---|---|---|---|---|---|---|---|---|

| ACC | IOU | Recall | ACC | IOU | Recall | ACC | IOU | Recall | |||

| SegNet | 0.889 7 | 0.801 9 | 0.886 7 | 0.892 6 | 0.566 4 | 0.888 7 | 0.860 3 | 0.557 9 | 0.857 3 | ||

| U-Net | 0.938 9 | 0.759 3 | 0.940 5 | 0.937 3 | 0.781 8 | 0.935 7 | 0.919 7 | 0.811 8 | 0.918 9 | ||

| Sep-UNet | 0.957 6 | 0.893 8 | 0.954 9 | 0.956 5 | 0.886 3 | 0.956 1 | 0.940 8 | 0.868 1 | 0.941 1 | ||

表4 模型效率对比Tab. 4 The comparison of model efficiency |

| 网络模型 | 单次迭代时间/(s/次) | 迭代次数/次 | 总时间/s |

|---|---|---|---|

| SegNet | 111 | 168 | 18 648 |

| U-Net | 102 | 152 | 15 504 |

| Sep-UNet | 113 | 124 | 14 012 |

表5 Sep-UNet模型的多场景提取结果Tab. 5 Extraction Results of Sep-UNet Model in multiple scene images |

| 云雾 | 建筑 | 城郊 | 公园 | ||

|---|---|---|---|---|---|

| 标准假彩色影像 |  |  |  |  | |

| 各样本集 模的提取 结果 | Fake样本集 |  |  |  |  |

| NDVI样本集 |  |  |  |  | |

| True样本集 |  |  |  |  | |

注:提取结果中白色区域为植被区域,黑色区域为非植被区域。 |

表6 Sep-UNet模型的多场景提取精度Tab. 6 Extraction precision of Sep-UNet model in multiple scene images |

| 场景 | Fake样本集 | NDVI样本集 | True样本集 | |||||||||||

|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|

| 云雾 | 建筑 | 城郊 | 公园 | 云雾 | 建筑 | 城郊 | 公园 | 云雾 | 建筑 | 城郊 | 公园 | |||

| ACC | 0.942 3 | 0.941 2 | 0.905 5 | 0.951 6 | 0.938 8 | 0.940 6 | 0.886 7 | 0.937 2 | 0.891 2 | 0.923 9 | 0.861 3 | 0.907 9 | ||

| IOU | 0.900 1 | 0.886 7 | 0.867 7 | 0.913 0 | 0.889 5 | 0.887 1 | 0.855 5 | 0.891 5 | 0.819 6 | 0.851 5 | 0.792 2 | 0.856 7 | ||

| Recall | 0.941 5 | 0.941 5 | 0.889 6 | 0.955 1 | 0.937 4 | 0.938 8 | 0.884 4 | 0.923 9 | 0.889 8 | 0.919 8 | 0.866 6 | 0.884 1 | ||

| [1] |

郭逸飞, 吴田军, 骆剑承, 等. 基于不确定性迭代优化的山地植被遥感制图[J]. 地球信息科学学报, 2022, 24(7):1406-1419.

[

|

| [2] |

王小勇. 空间光学技术发展与展望[J]. 航天返回与遥感, 2018, 39(4):79-86.

[

|

| [3] |

陈阳, 赵俊三, 陈应跃. 基于ENVI的高分辨率遥感影像城市绿地信息提取研究[J]. 测绘工程, 2015, 24(4):33-36.

[

|

| [4] |

|

| [5] |

|

| [6] |

徐建辉, 苏娅. 高分辨率遥感影像在城市绿地信息提取中的应用研究[J]. 资源开发与市场, 2010, 26(4):291-293,288.

[

|

| [7] |

陈仁喜, 王成芳. 城市高分辨率影像绿地植被识别研究进展[J]. 遥感信息, 2013, 28(3):119-125.

[

|

| [8] |

杨柳, 陈延辉, 岳德鹏, 等. 无人机遥感影像的城市绿地信息提取[J]. 测绘科学, 2017, 42(2):59-64.

[

|

| [9] |

李德仁, 童庆禧, 李荣兴, 等. 高分辨率对地观测的若干前沿科学问题[J]. 中国科学:地球科学, 2012, 42(06):805-813.

[

|

| [10] |

杨惠雯. 基于深度特征学习的高分辨率遥感影像分类[D]. 北京: 中国科学院大学, 2018.

[

|

| [11] |

周飞燕, 金林鹏, 董军. 卷积神经网络研究综述[J]. 计算机学报, 2017, 40(6):1229-1251.

[

|

| [12] |

|

| [13] |

|

| [14] |

张华, 郑祥成, 郑南山, 等. 基于MAEU-CNN的高分辨率遥感影像建筑物提取[J]. 地球信息科学学报, 2022, 24(6):1189-1203.

[

|

| [15] |

|

| [16] |

林禹, 赵泉华, 李玉. 一种基于深度传递迁移学习的遥感影像分类方法[J]. 地球信息科学学报, 2022, 24(3):495-507.

[

|

| [17] |

|

| [18] |

|

| [19] |

|

| [20] |

|

| [21] |

|

| [22] |

许明珠, 徐浩, 孔鹏. 结合植被指数和卷积神经网络的遥感植被分类方法[J]. 激光与光电子学进展, 2022, 59(24):273-285.

[

|

| [23] |

|

| [24] |

李前景, 刘珺, 米晓飞. 面向对象与卷积神经网络模型的GF-6 WFV影像作物分类[J]. 遥感学报, 2021, 25(2):549-558.

[

|

| [25] |

|

| [26] |

徐知宇, 周艺, 王世新. 面向GF-2遥感影像的U-Net城市绿地分类[J]. 中国图象图形学报, 2021, 26(3):700-713.

[

|

| [27] |

|

| [28] |

|

| [29] |

|

| [30] |

|

| [31] |

谢东津, 吕呈龙, 祖梅, 等. 绿色植被可见-近红外反射光谱模拟材料研究进展[J]. 光谱学与光谱分析, 2021, 41(4):1032-1038.

[

|

| [32] |

虞佳佳, 姬旭升, 李晓丽. 基于多/高光谱影像的农作物叶片像素自动提取方法[J]. 农业机械学报, 2022, 53(8):240-249.

[

|

| [33] |

|

| [34] |

姚静, 武文波, 康停军. 基于TM影像的城市绿地信息提取方法研究[J]. 测绘科学, 2010, 35(1):113-115.

[

|

/

| 〈 |

|

〉 |