改进HarDNet-MSEG的遥感影像水体信息提取方法

|

郭慧琳(1997— ),女,甘肃天水人,硕士生,研究方向为遥感信息的识别与提取。E-mail: txjg717824@163.com |

Copy editor: 蒋树芳

收稿日期: 2023-11-05

修回日期: 2024-01-28

网络出版日期: 2024-06-25

Water Body Extraction from Remote Sensing Images Based on Improved HarDNet-MSEG

Received date: 2023-11-05

Revised date: 2024-01-28

Online published: 2024-06-25

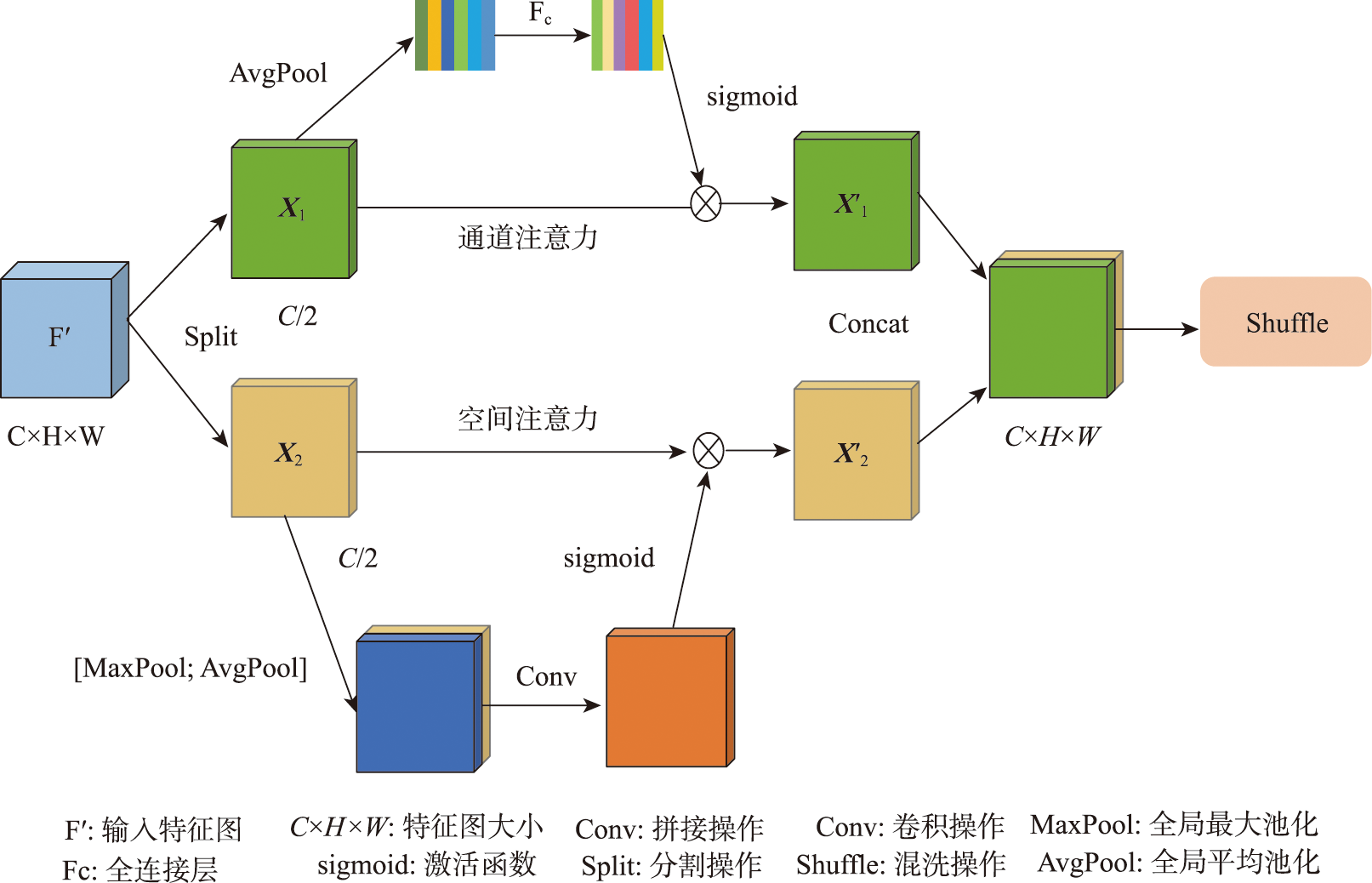

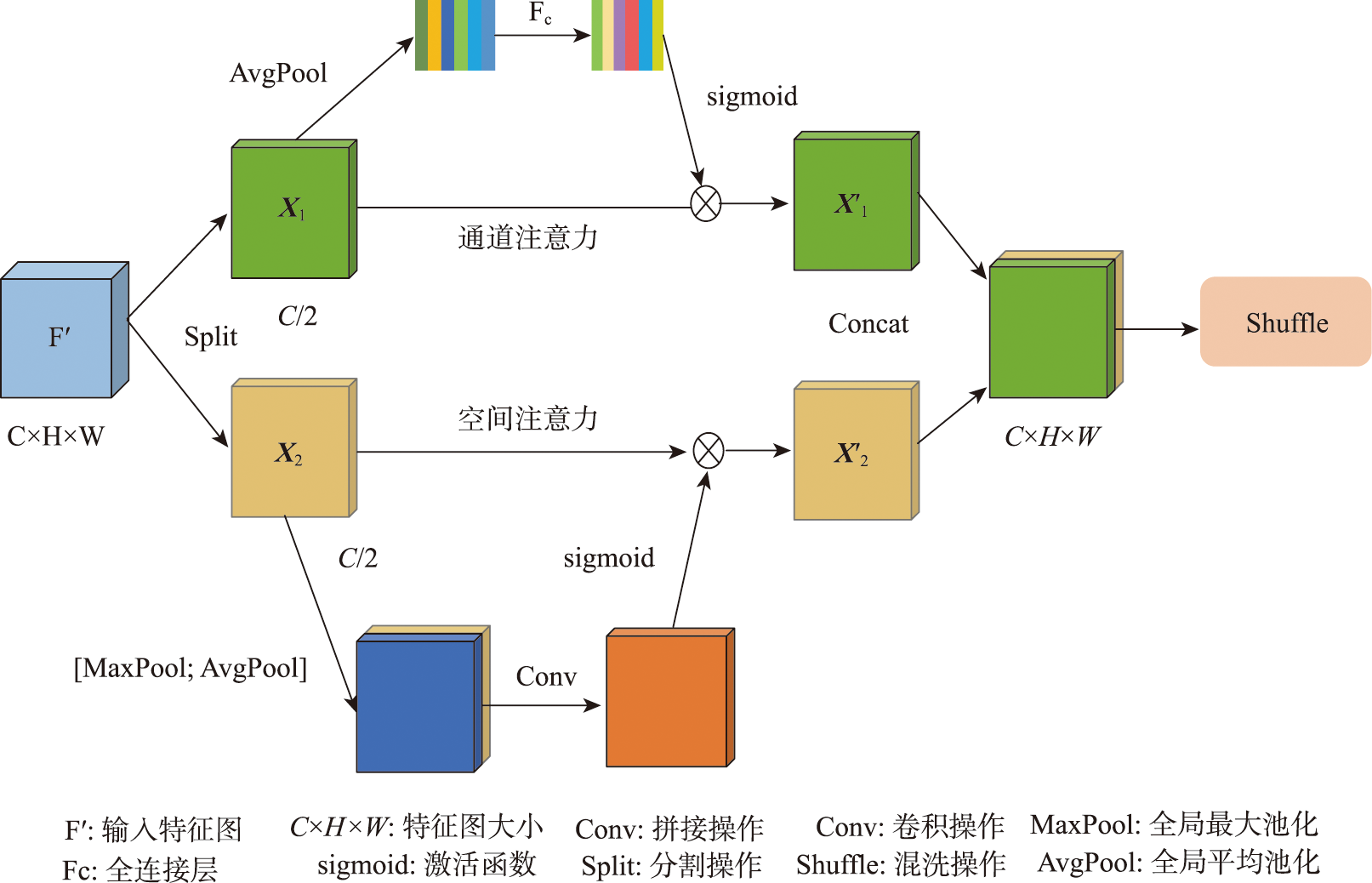

准确有效地提取水体信息,对于水资源监测、管理和应用等方面具有重要意义。由于水体形状、大小和分布的多样性以及场景的复杂性,如何高效准确地从遥感影像中提取出水体仍具有挑战性。传统的方法虽然可以从遥感图像中提取水体,但由于异物同谱其提取精度往往难以满足实际应用要求。因此,迫切需要先进的高性能技术来提高水体提取的效率和准确性。将深度学习与遥感技术相结合可以充分发挥深度学习的优势,有效帮助准确地提取水体信息。目前以深度学习的方法提取水体信息面临的挑战仍是多尺度特征融合、耗时长和参数多。HarDNet-MSEG (Harmonic DenseNet-MSEG)模型拥有较高的分割精度和较快的推理速度,为进一步充分利用来自通道和空间位置层面的相关信息以及提高模型的分割精度,本文以HarDNet-MSEG为网络框架,设计了一种名为HAM(Hybrid Attention Mechanism)的注意力机制,将其嵌入到HarDNet-MSEG网络中以探究其在网络中的最佳位置,在相同的实验环境下与其他注意力机制、经典网络算法以及传统的方法进行一系列的对比实验,并测试该模型在其他数据集上的通用性。结果表明, HAM模块在HarDNet-MSEG网络的较浅层处表现最出色。与其他注意力机制相比,HAM模块取得了更高的性能,MIoU、FWIoU和PA分别达到了94.068 7%、97.737 4%和99.320 5%。与DeepLabV3+、U-Net和PSPNet等经典模型相比, HarDNet-MSEG-HAM1模型不仅有最好的MIoU,参数量、计算量和训练时间各方面都表现出卓越的性能。与传统方法相比, HarDNet-MSEG-HAM1模型具有显著的优势,同时该模型在其他数据集上也表现出了良好的性能。最后,成功提取了青藏高原内流流域的2013、2016、2019和2022年4期湖泊,并对其面积变化进行了分析。一系列的实验数据表明,该模型在水体提取任务中的优越性与鲁棒性。本论文预期可以为从复杂场景的遥感影像中提取水体信息提供方法和相关数据支持。

郭慧琳 , 谢元礼 , 胡李发 , 雍佳乐 , 李云梅 , 孙韶启 . 改进HarDNet-MSEG的遥感影像水体信息提取方法[J]. 地球信息科学学报, 2024 , 26(7) : 1745 -1762 . DOI: 10.12082/dqxxkx.2024.230656

Accurately and efficiently mapping water bodies is of great significance for water resources monitoring, management, and application. It remains challenging to efficiently and accurately extract water bodies from remote sensing images due to the diversity of their shapes, sizes, distributions, and the complexity of the scenes. Although traditional methods can extract water bodies from remote sensing images, their extraction accuracy falls short of meeting the practical application requirements due to heterogeneous objects with the same spectrum. Therefore, there is an urgent demand for advanced high-performance techniques to improve the efficiency and accuracy of water body extraction. The combination of deep learning and remote sensing technology can fully exploit the advantages of deep learning and effectively contribute to the accurate extraction of water bodies. Current challenges in extracting water bodies through deep learning methods persist in issues such as multi-scale feature fusion, prolonged processing times, and the involvement of multiple parameters. The HarDNet-MSEG model possesses high segmentation accuracy and fast inference speed. In order to further fully utilize relevant information from the channel and spatial location levels, and to improve the segmentation accuracy of the model, this paper proposes a Hybrid Attention Mechanism (HAM) integrated into the HarDNet-MSEG network framework. The HAM is embedded into the HarDNet-MSEG network to explore its optimal position within the architecture, and a series of comparative experiments are conducted under the same experimental conditions, comparing it with other attention mechanisms, classical network algorithms, and traditional methods. Additionally, the generalizability of the model on other datasets is tested. The results show that the HAM module performs best at the shallower layers of the HarDNet-MSEG network. Compared with other attention mechanisms, the HAM module achieves higher performance, with MIoU, FWIoU, and PA reaching 94.0687%, 97.7374%, and 99.3205%, respectively. Compared with the classical models such as DeepLabV3+, U-Net, and PSPNet, the HarDNet-MSEG-HAM1 model not only achieves the highest MIoU but also demonstrates excellent performance in terms of parameter count, calculation volume, and training time. The HarDNet-MSEG-HAM1 model demonstrates significant advantages over the traditional methods, while also exhibiting favorable performance on other datasets. Finally, four phases of lakes in the endorheic Qinghai-Tibet Plateau in 2013, 2016, 2019, and 2022 are successfully extracted, and their area changes are analyzed. A series of experimental data demonstrate the superiority and robustness of the proposed model in water body extraction tasks. This study aims to provide a methodological framework and relevant data for extracting water bodies from complex remote sensing images.

表1 所获取影像的行列号Tab. 1 Row and column numbers of acquired images |

| 行号 | 130 | 131-134 | 135 | 136-140 | 141 | 142-144 | 145-146 | 147 | 148 | 149 | 150-151 | 152 |

|---|---|---|---|---|---|---|---|---|---|---|---|---|

| 列号 | 038-040 | 034-041 | 033-040 | 033-041 | 033-040 | 035-040 | 035-038 | 034-038 | 037 | 033-037 | 033-036 | 033-035 |

表2 实验环境Tab. 2 Experimental environment |

| 操作系统 | CPU | 内存 | GPU | CUDA | 深度学习框架 |

|---|---|---|---|---|---|

| Windows 10 | Intel (R) Core(TM) i7-12700F | 16 GB | NVIDIA GeForce RTX 3060 12 GB | 11.6 | Pytorch1.13 |

表3 不同模型的训练结果Tab. 3 Training results of different models (%) |

| 模型 | MIoU | FWIoU | PA |

|---|---|---|---|

| HarDNet-MSEG | 92.939 4 | 96.724 8 | 98.318 7 |

| HarDNet-MSEG-HAM1 | 94.068 7 | 97.737 4 | 99.320 5 |

| HarDNet-MSEG-HAM2 | 92.954 6 | 96.957 2 | 98.976 9 |

| HarDNet-MSEG-HAM3 | 93.984 1 | 97.328 1 | 98.917 4 |

| HarDNet-MSEG-CBAM | 93.016 5 | 96.921 5 | 98.610 6 |

| HarDNet-MSEG-SE | 93.692 5 | 97.035 5 | 98.478 5 |

表4 不同语义分割网络的训练结果Tab. 4 Training results of different semantic segmentation networks |

| 分析方法 | 具体内容 | 模型 | |||

|---|---|---|---|---|---|

| HarDNet-MSEG-HAM1 | DeepLabV3+ | U-Net | PSPNet | ||

| 定量分析 | MIoU/% | 94.068 7 | 92.468 6 | 93.429 8 | 92.932 9 |

| 参数量/M | 21.00 | 45.70 | 51.50 | 43.30 | |

| FLOPs/G | 34.36 | 56.60 | 62.40 | 11.97 | |

| 训练耗时/h | 32.60 | 42.20 | 45.70 | 26.60 | |

| 定性分析 | 场景一 | 几乎无错分漏分现象 | 存在较多的漏分 | 存在较少 的空洞 | 几乎无错分漏分现象 |

| 场景二 | 完整地提取出了较大面积的湖泊 | 边界提取不完整, 存在漏提 | 存在严重 的漏提 | 边界提取较为精细, 但也存在漏提 | |

| 场景三 | 完整地保留了细长湖泊 | 不能完整地提取出细长湖泊,漏分现象严重 | |||

| 场景四 | 提取的湖泊边界平滑且规整、 无空洞现象 | 能大致分割出湖泊边界,但是分割 不精细且不完整 | 对边界的识别特别粗糙且不完整 | ||

表5 不同方法的水体提取结果Tab. 5 Results of water extraction by different methods |

| 分析方法 | 具体内容 | 模型 | ||||

|---|---|---|---|---|---|---|

| HarDNet-MSEG-HAM1 | MNDWI | NDWI | 单波段阈值法 | SVM | ||

| 定量分析 | 总体精度/% | 96.191 5 | 93.253 5 | 93.035 9 | 92.818 3 | 91.839 0 |

| Kappa | 0.923 1 | 0.864 3 | 0.857 9 | 0.855 4 | 0.833 6 | |

| 定性分析 | 场景一 | 能够有效区分山体阴影和水体,仅有少量阴影被错误地识别为水体 | 将大量山体阴影错误地识别为水体 | |||

| 场景二 | 能有效区分水体与云及其阴影 | 将云错误地 识别为水体 | 将云及其阴影 都误认为水体 | 将云的阴影错误地识别为水体 | ||

表6 HarDNet-MSEG-HAM1在其他数据集上的提取精度Tab. 6 Extraction accuracy of HarDNet-MSEG-HAM1 on other datasets (%) |

| 数据集 | MIoU | FWIoU | PA |

|---|---|---|---|

| WHDLD | 92.910 9 | 94.703 4 | 97.276 4 |

| 腾格里沙漠 | 93.164 9 | 97.609 3 | 98.741 9 |

表7 4个时期内流流域的湖泊总面积Tab. 7 Total area of lakes in the inland lake areas during the four time periods |

| 年份 | 本文的提取 结果/km2 | 参考文献[50]的 提取结果/km2 | 参考文献[53]的 提取结果/km2 |

|---|---|---|---|

| 2013 | 29 478.78 | 32 851.39 | — |

| 2016 | 33 305.82 | 33 532.78 | 32 395.15 |

| 2019 | 35 157.80 | 35 413.30 | 34 689.05 |

| 2022 | 35 079.76 | 35 258.33 | — |

| [1] |

|

| [2] |

陈鹏, 张青, 李倩. 基于FY3A/MERSI影像的几种常用水体提取方法的比较分析[J]. 干旱区地理, 2015, 38(4):770-778.

[

|

| [3] |

杜云艳, 周成虎. 水体的遥感信息自动提取方法[J]. 遥感学报, 1998, 2(4):264-269.

[

|

| [4] |

王国华, 裴亮, 杜全叶, 等. 针对资源三号卫星影像水体提取的谱间关系法[J]. 遥感信息, 2020, 35(3):117-121.

[

|

| [5] |

杨树文, 薛重生, 刘涛, 等. 一种利用TM影像自动提取细小水体的方法[J]. 测绘学报, 2010, 39(6):611-617.

[

|

| [6] |

李丹, 吴保生, 陈博伟, 等. 基于卫星遥感的水体信息提取研究进展与展望[J]. 清华大学学报(自然科学版), 2020, 60(2):147-161.

[

|

| [7] |

|

| [8] |

徐涵秋. 利用改进的归一化差异水体指数(MNDWI)提取水体信息的研究[J]. 遥感学报, 2005, 9(5):589-595.

[

|

| [9] |

丁凤. 一种基于遥感数据快速提取水体信息的新方法[J]. 遥感技术与应用, 2009, 24(2):167-171.

[

|

| [10] |

|

| [11] |

朱小强, 丁建丽, 夏楠, 等. 一种稳定阈值的湖泊水体信息提取方法[J]. 资源科学, 2019, 41(4):790-802.

[

|

| [12] |

邓开元, 任超. 多光谱光学遥感影像水体提取模型[J]. 测绘学报, 2021, 50(10):1370-1379.

[

|

| [13] |

|

| [14] |

|

| [15] |

|

| [16] |

陈云浩, 冯通, 史培军, 等. 基于面向对象和规则的遥感影像分类研究[J]. 武汉大学学报(信息科学版), 2006, 31(4):316-320.

[

|

| [17] |

|

| [18] |

|

| [19] |

|

| [20] |

|

| [21] |

|

| [22] |

|

| [23] |

|

| [24] |

|

| [25] |

|

| [26] |

|

| [27] |

|

| [28] |

梁泽毓, 吴艳兰, 杨辉, 等. 基于密集连接全卷积神经网络的遥感影像水体全自动提取方法[J]. 遥感信息, 2020, 35(4):68-77.

[

|

| [29] |

丁成, 翁理国, 夏旻, 等. 多注意力机制网络卫星图像分割算法[J]. 计算机工程与应用, 2021, 57(2):223-229.

[

|

| [30] |

|

| [31] |

|

| [32] |

|

| [33] |

|

| [34] |

|

| [35] |

|

| [36] |

|

| [37] |

|

| [38] |

|

| [39] |

|

| [40] |

|

| [41] |

|

| [42] |

|

| [43] |

|

| [44] |

|

| [45] |

|

| [46] |

|

| [47] |

|

| [48] |

|

| [49] |

张镱锂, 李炳元, 刘林山, 等. 再论青藏高原范围[J]. 地理研究, 2021, 40(6):1543-1553.

[

|

| [50] |

|

| [51] |

|

| [52] |

|

| [53] |

|

| [54] |

|

/

| 〈 |

|

〉 |