复杂背景下轻量级SAR影像船舶检测方法

|

高 定(1998— ),男,山西大同人,硕士生,主要从事摄影测量与遥感方向研究。E-mail: 260268004@qq.com |

Copy editor: 蒋树芳 , 黄光玉

收稿日期: 2023-09-11

修回日期: 2023-10-31

网络出版日期: 2024-11-07

基金资助

国家自然科学基金项目(41971427)

国家自然科学基金项目(42371459)

嵩山实验室项目(221100211000-5)

高分遥感测绘应用示范系统(二期)(42-Y30B04-9001-19/21)

A Ship Detection Method from Lightweight SAR Images under Complex Backgrounds

Received date: 2023-09-11

Revised date: 2023-10-31

Online published: 2024-11-07

Supported by

National Natural Science Foundation of China(41971427)

National Natural Science Foundation of China(42371459)

Songshan Laboratory Project(221100211000-5)

The High Resolution Remote Sensing, Surveying and Mapping Application Demonstration System (Phase II)(42-Y30B04-9001-19/21)

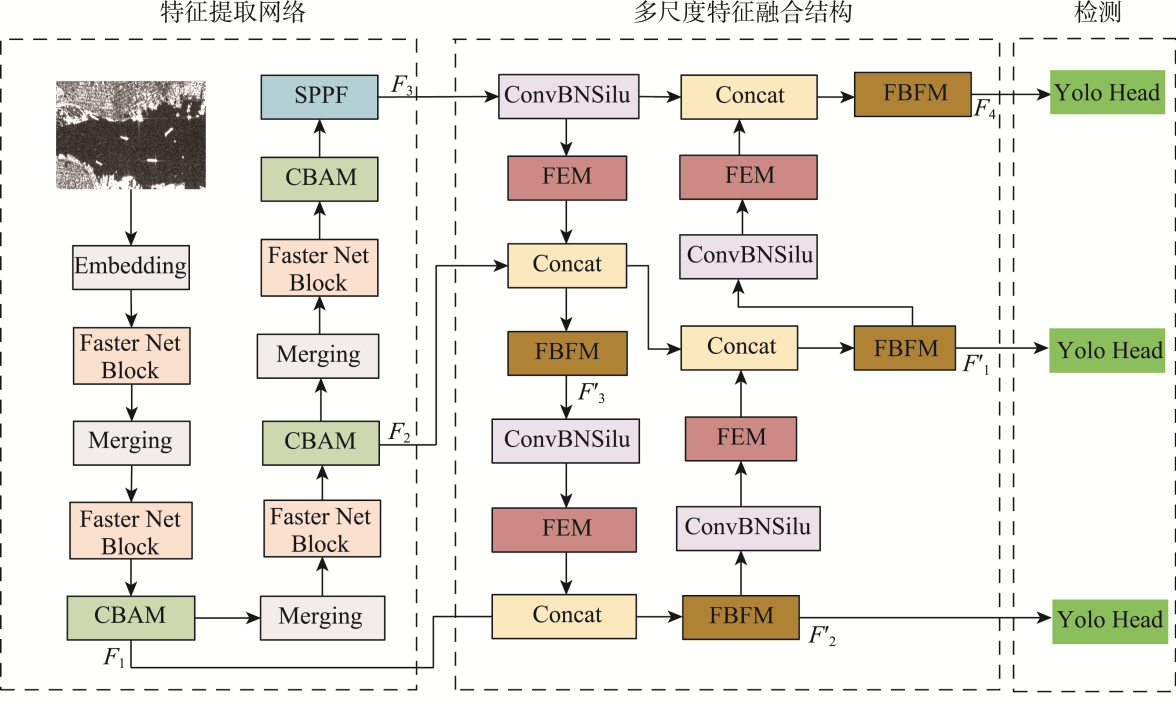

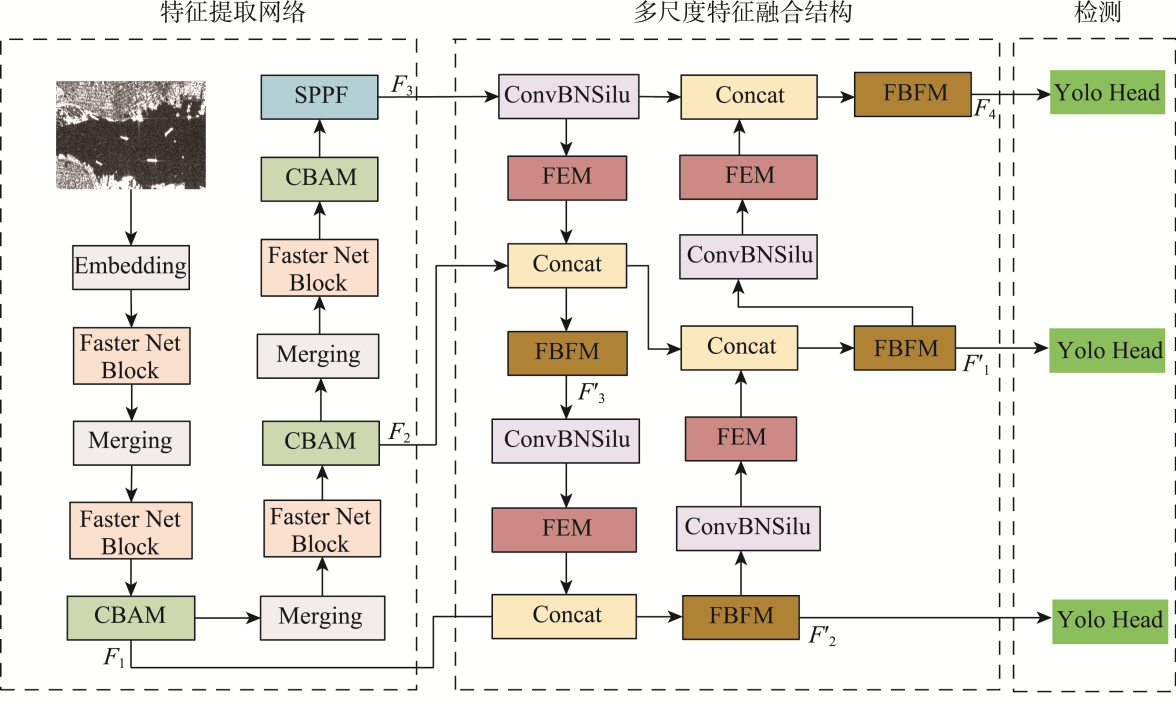

合成孔径雷达(SAR)影像船舶检测在海上监视、海上贸易和海上救援等领域有着广泛的实际应用价值,随着星上在轨自主处理发展的需求,对星上SAR影像船舶在轨实时检测提出了更高的要求。因此针对当前卫星硬件资源有限、SAR影像船舶目标特征尺度多样化、易受噪声干扰等问题,本文提出了一种复杂背景下轻量级SAR影像船舶检测算法。首先,采用FasterNet结合注意力机制提取目标的高低级特征;其次,为解决目标多尺度问题,构建了一种特征增强模块(FEM),在增加感受野的同时,提高了目标检测能力;然后,构造结合特征增强的多尺度特征融合结构,将主干网络提取的多尺度特征进行增强和融合,加强不同层级特征联系的同时获取目标多尺度的上下文信息,并在输出特征图中进行SAR影像船舶检测;最后,在SSDD、HRSID以及二者合并的数据集上,将本文方法与主流算法进行对比实验。实验结果表明,本文方法平均准确率分别为98.6%、92.3%和93.0%,召回率分别为95.10%、85.10%和86.8%,模型尺寸和参数量仅为8.8 MB和4.2 M,均明显优于其他方法,并且查准率和检测速率也具有很大的优势,有利于迁移到实际的应用中。

高定 , 李明 , 范大昭 , 董杨 , 李志新 , 王刃 . 复杂背景下轻量级SAR影像船舶检测方法[J]. 地球信息科学学报, 2024 , 26(11) : 2612 -2625 . DOI: 10.12082/dqxxkx.2024.230544

The ship target detection methods using Synthetic Aperture Radar (SAR) images have a wide range of practical applications in many fields such as surveillance on the sea surface, trade to and from the sea surface, and emergency rescue on the sea surface, etc. With the demand for the development of autonomous processing in satellite orbits, the real-time in-orbit detection and localization of ships from SAR images have put forward higher requirements. Therefore, this paper proposes a lightweight SAR image ship detection algorithm in a complex background for the current problems of limited satellite hardware resources, diverse and differentiated feature scales of different ship targets in Synthetic Aperture Radar (SAR) images, and easy to be interfered by noise. First of all, the FasterNet network model combined with the attention mechanism is used to extract different high and low level features of the target. Second, in order to solve the problem of scale inconsistency between different targets, this paper constructs a Feature Enhancement Module (FEM) that can not only increase the network sensory field at the same time but also improve the ability of network target detection. Then, a multi-scale feature fusion structure combined with feature enhancement is constructed in this paper, which can enhance and fuse the multi-scale features extracted by the backbone feature extraction network, and can also strengthen the connection between the features of different layers of the network while obtaining the multi-scale contextual information of the target, and carry out the detection of the SAR image ship in the three feature maps output from the multi-scale feature fusion structure combined with feature enhancement. Experiments are conducted to compare the proposed method with some other mainstream target detection algorithms on SSDD, HRSID, and merged SSDD and HRSID datasets. The results show that the average accuracy of the proposed methods on three datasets in this paper is 98.6%, 92.3% and 93.0%, respectively. The recall of the method in this paper is 95.10%, 85.10% and 86.8%, respectively, for three datasets. The model size and parameter number of the proposed method in this paper are only 8.8 MB and 4.2 M, respectively. The proposed method significantly outperforms other algorithms in terms of recall and average accuracy ratio. Moreover, the method in this paper also has great advantages in terms of checking accuracy and detection rate, which is favorable to be migrated to other practical applications.

表1 算法各模块检测精度的评估结果Tab. 1 Evaluation results of detection accuracy of each module of the algorithm |

| 更换主干 | CBAM | FEM&MFF | 方法 | P/% | R/% | mAP/% |

|---|---|---|---|---|---|---|

| × | × | × | Yolov5s | 94.7 | 94.1 | 96.7 |

| √ | × | × | 改进1 | 96.0 | 93.9 | 97.1 |

| √ | √ | × | 改进2 | 96.6 | 90.4 | 97.6 |

| √ | √ | √ | 本文方法 | 96.0 | 95.1 | 98.3 |

注:加粗字体表示结果最优,FEM表示特征增强,MFF表示多特征融合。 |

表2 算法各模块模型尺寸和参数量的评估结果Tab. 2 Evaluation results of model sizes and parametric quantities for each module of the algorithm |

| 更换主干 | CBAM | FEM&MFF | 方法 | Model Size/MB | Parameters/M |

|---|---|---|---|---|---|

| × | × | × | Yolov5s | 14.5 | 7.0 |

| √ | × | × | 改进1 | 7.4 | 3.5 |

| √ | √ | × | 改进2 | 7.5 | 3.6 |

| √ | √ | √ | 本文方法 | 8.8 | 4.2 |

注:加粗字体表示结果最优,FEM表示特征增强,MFF表示多特征融合。 |

表3 本文算法与其他算法在SSDD数据集性能对比结果Tab. 3 The performance of this algorithm is compared with other four algorithms in SSDD |

| 算法 | P/% | R/% | mAP/% | Model Size/MB | Parameters/M | FPS/(frams/s) |

|---|---|---|---|---|---|---|

| Faster r-cnn | 84.9 | 76.5 | 85.1 | 108.1 | 41.1 | 31.4 |

| SSD | 86.0 | 70.0 | 86.8 | 90.6 | 23.6 | 59.1 |

| Yolv5s | 94.7 | 94.1 | 96.7 | 14.5 | 7.0 | 37.3 |

| Yolov7-tiny | 95.7 | 92.1 | 97.6 | 12.3 | 6.2 | 24.0 |

| YOLOv4-LITE | 94.0 | 92.6 | 95.0 | 49.3 | — | 47.2 |

| EfficientYOLO | 96.1 | 85.7 | 93.6 | 31.3 | 8.2 | 68.5 |

| 本文算法 | 96.0 | 95.1 | 98.3 | 8.8 | 4.2 | 44.2 |

注:加粗数值表示结果最优。 |

表4 本文算法与其他算法在HRSID数据集对比结果Tab. 4 The performance of this algorithm is compared with other four algorithms in HRSID |

| 算法 | P/% | R/% | mAP/% | Model Size/MB | Parameters/M | FPS/(frams/s) |

|---|---|---|---|---|---|---|

| Faster r-cnn | 84.1 | 76.2 | 84.3 | 108.1 | 41.1 | 33.5 |

| SSD | 76.9 | 70.8 | 69.5 | 90.6 | 23.6 | 59.1 |

| Yolv5s | 92.1 | 82.3 | 90.9 | 14.5 | 7.0 | 35.5 |

| Yolov7-tiny | 91.4 | 80.8 | 89.5 | 12.3 | 6.2 | 22.7 |

| EfficientYOLO | 93.4 | 72.5 | 87.06 | 31.3 | 8.2 | 49.7 |

| 本文算法 | 92.5 | 85.1 | 92.30 | 8.8 | 4.2 | 48.2 |

注:加粗数值表示结果最优。 |

表5 本文算法与其他算法在数据集HRSID和SSDD合并后的对比结果Table 5 Comparison results of this paper's algorithm with other algorithms after merging the datasets HRSID and SSDD |

| 算法 | P/% | R/% | mAP/% | Model Size/MB | Parameters/M | FPS/(frams/s) |

|---|---|---|---|---|---|---|

| Faster r-cnn | 85.7 | 73.8 | 84.1 | 108.1 | 41.1 | 45.5 |

| SSD | 75.6 | 71.5 | 71.9 | 90.6 | 23.6 | 77.3 |

| Yolv5s | 92.3 | 85.7 | 91.3 | 14.5 | 7.0 | 31.8 |

| Yolov7-tiny | 91.9 | 82.1 | 90.4 | 12.3 | 6.2 | 29.4 |

| 本文算法 | 92.0 | 86.8 | 93.0 | 8.8 | 4.2 | 57.5 |

注:加粗数值表示结果最优。 |

| [1] |

纪松, 张永生, 董杨, 等. 星载轻量化影像控制点数据制作方法[J]. 测绘学报, 2022, 51(3):413-425.

[

|

| [2] |

杨志柳. 面向遥感图像特殊目标检测算法的星载实时处理器实现[D]. 北京: 北京理工大学, 2016.

[

|

| [3] |

|

| [4] |

|

| [5] |

赵婷, 王申涛, 牛林, 等. 合成孔径雷达图像舰船尾迹检测算法[J]. 上海交通大学学报, 2020, 54(12):1259-1268.

[

|

| [6] |

郭佳兴. 基于卷积神经网络的SAR图像舰船检测[D]. 西安: 西安电子科技大学, 2022.

[

|

| [7] |

|

| [8] |

|

| [9] |

|

| [10] |

|

| [11] |

|

| [12] |

|

| [13] |

|

| [14] |

周舟, 王海鹏, 徐丰, 等. 基于通道剪枝的SAR图像舰船检测优化算法[J]. 上海航天, 2020, 37(4):48-54.

[

|

| [15] |

张丽丽, 王贤俊, 屈乐乐, 等. SAR图像舰船检测的神经网络关联剪枝方法[J]. 雷达科学与技术, 2024, 22(3):284-290,299.

[

|

| [16] |

陈诗琪, 王威, 占荣辉, 等. 特征图知识蒸馏引导的轻量化任意方向SAR舰船目标检测器[J]. 雷达学报, 2023, 12(1):140-153.

[

|

| [17] |

|

| [18] |

|

| [19] |

|

| [20] |

|

| [21] |

|

| [22] |

|

| [23] |

|

| [24] |

|

| [25] |

|

| [26] |

|

| [27] |

|

| [28] |

|

| [29] |

|

/

| 〈 |

|

〉 |