改进区间二型模糊神经网络的遥感图像分割方法

|

王春艳(1981— ),女,辽宁阜新人,博士,教授,主要从事遥感信息识别与提取研究。E-mail: wangchunyan@lntu.edu.cn |

Copy editor: 黄光玉 , 蒋树芳

收稿日期: 2024-10-02

修回日期: 2024-12-14

网络出版日期: 2025-01-24

基金资助

国家自然科学基金青年科学基金项目(41801368)

辽宁省教育厅基本科研项目(青年项目)(LJKOZ2021154)

Improved Interval Type-2 Fuzzy Neural Network for Remote Sensing Image Segmentation

Received date: 2024-10-02

Revised date: 2024-12-14

Online published: 2025-01-24

Supported by

National Natural Science Foundation of China (Youth Science Fund)(41801368)

Liaoning Education Department's Basic Research Project (Youth Project)(LJKOZ2021154)

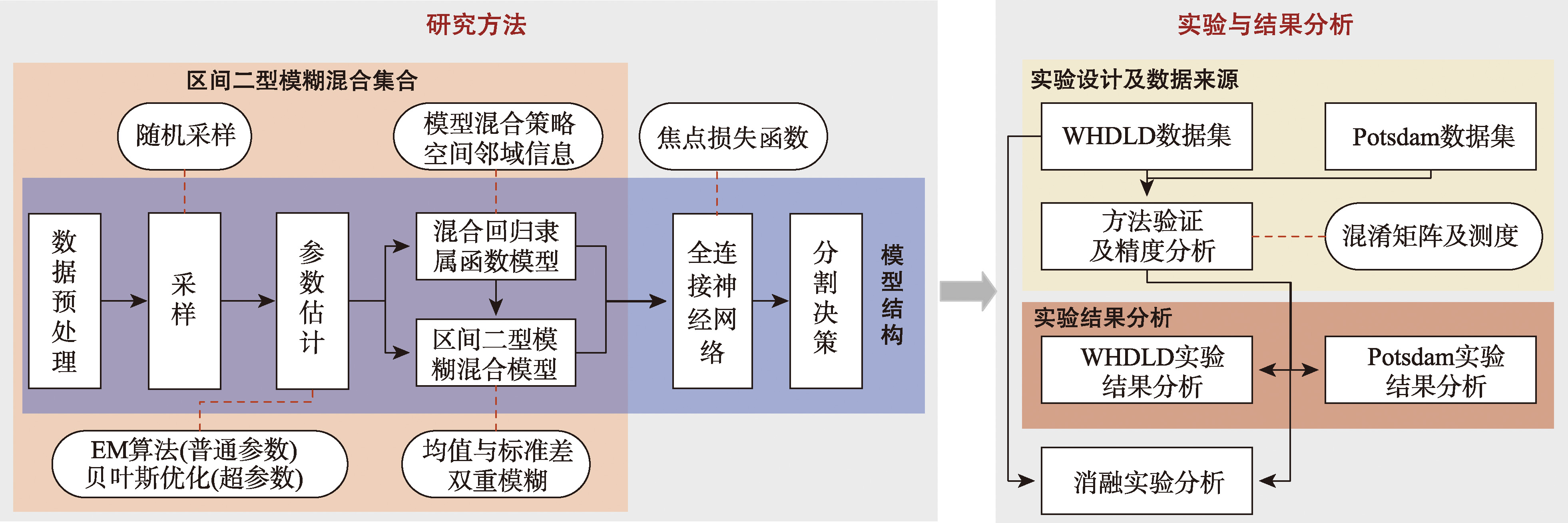

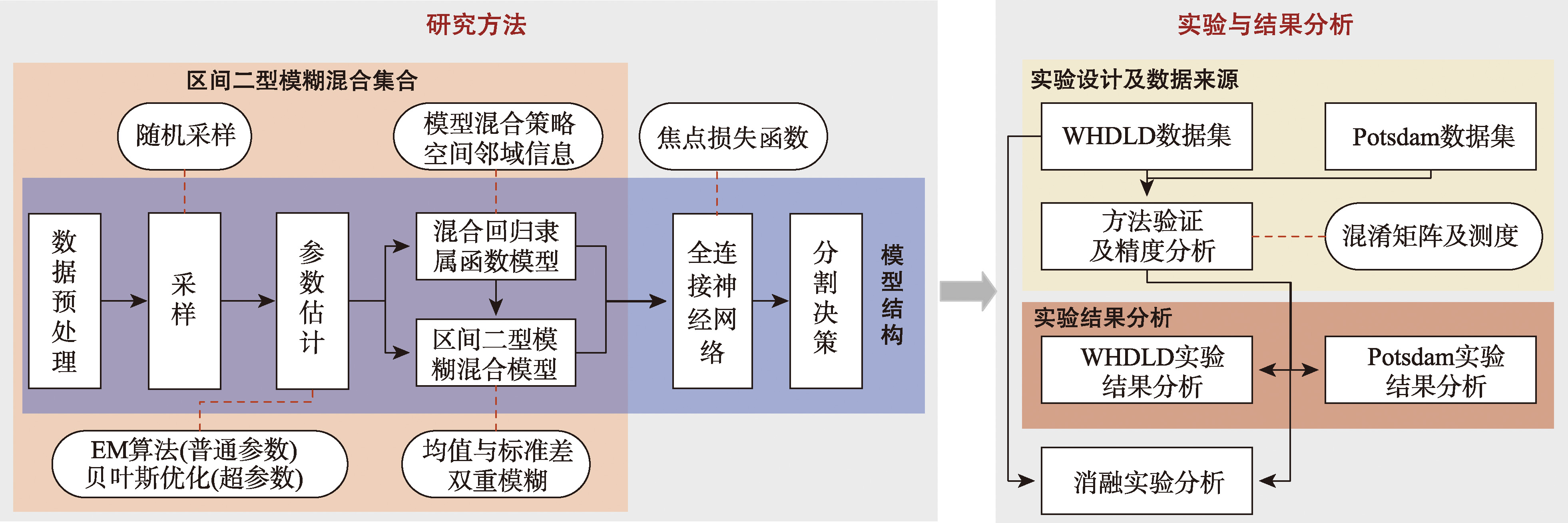

【目的】 高分辨率遥感图像具有丰富和精细的空间信息,但其丰富的细节却模糊了不同土地覆盖类型间的界限,增加了分割的模糊性和不确定性。针对遥感图像分割领域的这一问题,本文提出一种改进区间二型模糊神经网络的新型遥感图像分割方法。【方法】 该方法通过引入空间邻域信息及模型混合策略,构建混合回归隶属函数,实现对数据复杂特征的精细表达,以提升模型的适应性和特征提取能力;通过构建混合回归隶属函数的不确定区域来映射模糊和不确定的遥感数据特征,提高模型的鲁棒性;使用全连接神经网络结构进行特征整合,进一步增强模型的学习能力,同时引入焦点损失函数缓解类别不平衡问题的影响。【结果】 在WHDLD和Potsdam数据集上进行的地物类别分割实验中,提出方法的分割精度优于DeepLab v3+和UNet++,与区间二型模糊神经网络方法相比,总体精度平均提升了8.31%和10.48%,Kappa值提升14.07%和14.59%,F1-score提升16.36%和12.31%。【结论】 实验结果表明,提出方法成功应对了遥感图像分割中的模糊性和不确定性,有效缓解了土地覆盖分割中区域噪声造成的影响,具有分割精度高、泛化能力强等特点。

王春艳 , 王子康 . 改进区间二型模糊神经网络的遥感图像分割方法[J]. 地球信息科学学报, 2025 , 27(2) : 522 -535 . DOI: 10.12082/dqxxkx.2025.240549

[Objectives] High-resolution remote sensing images offer a wealth of detailed spatial information. However, this abundance of detail can blur the boundaries between different land cover types, thereby increasing the ambiguity and uncertainty of segmentation. To address this challenge in remote sensing image segmentation, this paper introduces an innovative segmentation method based on an improved interval type-2 fuzzy neural network. [Methods] By leveraging spatial neighborhood information and a model mixing strategy, a hybrid regression membership function is constructed to enable the precise representation of complex data features, thereby enhancing the model's adaptability and feature extraction capability. The uncertain region of the hybrid regression membership function is designed to map the fuzzy and uncertain features of remote sensing data, improving the model's robustness. The proposed approach utilizes a fully connected neural network architecture to enhance the model's capacity for feature integration and learning while incorporating a focal loss function to address the effects of class imbalance. [Results] In land cover segmentation experiments conducted on the WHDLD and Potsdam datasets, the proposed method significantly outperformed DeepLab v3+ and UNet++. The proposed method achieved average overall accuracy improvements of 8.31% and 10.48%, Kappa coefficient enhancements of 14.07% and 14.59%, and F1 score increases of 16.36% and 12.31%, compared to the interval type-2 fuzzy neural network. [Conclusions] The results demonstrate that the proposed method effectively addresses ambiguity and uncertainty in remote sensing image segmentation, significantly mitigating the impact of regional noise on land cover segmentation while achieving high segmentation accuracy and robust generalization capabilities.

表1 WHDLD数据集中各方法的分割性能评价指标Tab. 1 WHDLD segmentation task performance metrics for various methods |

| 方法 | OA | Kappa | Precision | Recall | F1-score | mIoU | FWIoU |

|---|---|---|---|---|---|---|---|

| DF | 0.786 3 | 0.618 6 | 0.631 2 | 0.575 1 | 0.601 8 | 0.380 7 | 0.625 2 |

| IT2FM_GMM | 0.642 1 | 0.518 4 | 0.592 2 | 0.678 3 | 0.632 0 | 0.365 2 | 0.484 3 |

| IT2FM_NWA | 0.676 3 | 0.559 8 | 0.608 3 | 0.699 7 | 0.650 4 | 0.379 8 | 0.501 9 |

| IT2FNN | 0.842 6 | 0.749 2 | 0.701 3 | 0.774 5 | 0.735 7 | 0.645 7 | 0.714 4 |

| DeepLab v3+ | 0.869 4 | 0.789 5 | 0.778 3 | 0.834 6 | 0.805 6 | 0.686 6 | 0.782 9 |

| UNet++ | 0.882 8 | 0.815 6 | 0.803 8 | 0.851 9 | 0.826 8 | 0.731 8 | 0.815 7 |

| 本文方法 | 0.925 7 | 0.889 9 | 0.865 1 | 0.936 3 | 0.899 3 | 0.832 5 | 0.843 4 |

表2 WHDLD数据集中各类别分割精度Tab. 2 Segmentation accuracy for various classes in WHDLD |

| 方法 | 水 | 建筑物 | 裸露土壤 | 植被 | 人行道 | 道路 |

|---|---|---|---|---|---|---|

| DF | 0.820 1 | 0.147 9 | 0.110 3 | 0.675 3 | 0.423 5 | 0.215 0 |

| IT2FM_GMM | 0.940 6 | 0.463 1 | 0.535 0 | 0.212 2 | 0.307 7 | 0.549 5 |

| IT2FM_NWA | 0.953 6 | 0.598 2 | 0.551 6 | 0.149 4 | 0.292 5 | 0.615 2 |

| IT2FNN | 0.910 6 | 0.953 2 | 0.779 5 | 0.636 7 | 0.668 3 | 0.848 8 |

| DeepLab v3+ | 0.925 3 | 0.765 8 | 0.694 3 | 0.901 7 | 0.689 1 | 0.757 6 |

| UNet++ | 0.955 3 | 0.760 9 | 0.417 2 | 0.914 4 | 0.695 5 | 0.826 0 |

| 本文方法 | 0.927 1 | 0.955 0 | 0.953 3 | 0.810 7 | 0.931 4 | 0.957 3 |

表3 Potsdam数据集中各方法的分割性能评价指标Tab. 3 Potsdam segmentation task performance metrics for various methods |

| 方法 | OA | Kappa | Precision | Recall | F1-score | mIoU | FWIoU |

|---|---|---|---|---|---|---|---|

| DF | 0.756 3 | 0.606 3 | 0.571 2 | 0.536 4 | 0.539 1 | 0.414 1 | 0.600 6 |

| IT2FM_GMM | 0.605 7 | 0.445 9 | 0.459 6 | 0.493 1 | 0.454 8 | 0.361 4 | 0.459 6 |

| IT2FM_NWA | 0.640 4 | 0.540 5 | 0.571 3 | 0.665 2 | 0.576 5 | 0.403 6 | 0.512 6 |

| IT2FNN | 0.798 7 | 0.720 8 | 0.738 3 | 0.791 6 | 0.751 2 | 0.579 7 | 0.672 1 |

| DeepLab v3+ | 0.863 4 | 0.801 2 | 0.805 1 | 0.842 8 | 0.824 6 | 0.766 2 | 0.801 4 |

| UNet++ | 0.880 1 | 0.825 9 | 0.820 2 | 0.890 4 | 0.853 4 | 0.783 6 | 0.805 3 |

| 本文方法 | 0.903 5 | 0.866 7 | 0.835 6 | 0.937 1 | 0.874 3 | 0.807 7 | 0.819 9 |

表4 Potsdam数据集中各类别的分割精度Tab. 4 Segmentation accuracy for various classes in Potsdam |

| 方法 | 建筑物 | 杂项 | 树木 | 低矮植被 | 汽车 | 不透水面 |

|---|---|---|---|---|---|---|

| DF | 0.128 9 | 0.108 3 | 0.320 4 | 0.425 4 | 0.192 2 | 0.810 3 |

| IT2FM_GMM | 0.503 3 | 0.123 7 | 0.426 5 | 0.533 9 | 0.344 9 | 0.427 3 |

| IT2FM_NWA | 0.534 5 | 0.108 4 | 0.437 5 | 0.539 4 | 0.358 8 | 0.427 5 |

| IT2FNN | 0755 5 | 0.718 6 | 0.710 0 | 0.740 2 | 0.949 3 | 0.732 0 |

| DeepLab v3+ | 0.866 4 | 0.485 9 | 0.790 1 | 0.830 7 | 0.862 5 | 0.887 8 |

| UNet++ | 0.869 1 | 0.536 4 | 0.793 0 | 0.893 9 | 0.885 0 | 0.889 4 |

| 本文方法 | 0.879 4 | 0.947 5 | 0.799 3 | 0.954 2 | 0.951 7 | 0.793 1 |

表5 消融实验改进点对比分析Tab. 5 Comparative analysis of enhancements in ablation experiments |

| 编号 | 基线 | 点P1 | 点P2 | 点P3 | OA | Kappa | Precision | Recall | F1-score | mIoU | FWIoU |

|---|---|---|---|---|---|---|---|---|---|---|---|

| E1 | √ | 0.842 6 | 0.749 2 | 0.701 3 | 0.774 5 | 0.735 7 | 0.645 7 | 0.714 4 | |||

| E2 | √ | √ | 0.859 9 | 0.793 8 | 0.724 1 | 0.835 9 | 0.777 6 | 0.671 4 | 0.733 2 | ||

| E3 | √ | √ | √ | 0.873 4 | 0.816 6 | 0.753 4 | 0.863 0 | 0.804 6 | 0.699 8 | 0.768 5 | |

| E4 | √ | √ | 0.896 0 | 0.849 7 | 0.816 2 | 0.881 1 | 0.847 6 | 0.764 6 | 0.798 1 | ||

| E5 | √ | √ | √ | 0.910 5 | 0.871 9 | 0.849 3 | 0.901 2 | 0.874 4 | 0.797 8 | 0.815 2 | |

| E6 | √ | √ | √ | √ | 0.925 7 | 0.889 9 | 0.865 1 | 0.936 3 | 0.899 3 | 0.832 5 | 0.843 4 |

| [1] |

|

| [2] |

|

| [3] |

|

| [4] |

|

| [5] |

|

| [6] |

孙显, 孟瑜, 刁文辉, 等. 智能遥感:AI赋能遥感技术[J]. 中国图象图形学报, 2022, 27(6):1799-1822.

[

|

| [7] |

邹同元, 丁火平, 王玮哲, 等. 天基遥感大数据人工智能应用探讨[J]. 卫星应用, 2019(6):38-44.

[

|

| [8] |

刘春娟, 辛钰强, 吴小所, 等. 双注意力引导的U-Net++遥感图像语义分割模型[J/OL]. 北京航空航天大学学报, 2024,1-13[2024-12-14].

[

|

| [9] |

|

| [10] |

南国君, 王敏, 都海波, 等. 基于改进Deeplabv3+模型的遥感影像地物语义分割方法研究[J/OL]. 控制与决策, 2024,1-9[2024-12-14].

[

|

| [11] |

|

| [12] |

|

| [13] |

|

| [14] |

|

| [15] |

|

| [16] |

|

| [17] |

|

| [18] |

|

| [19] |

|

| [20] |

|

| [21] |

|

| [22] |

|

| [23] |

王春艳, 金鹏, 桂琪皓. 区间二型模糊神经网络遥感图像分割方法[J]. 测绘科学, 2024, 49(5):84-98.

[

|

| [24] |

|

| [25] |

|

| [26] |

袁立, 袁吉收, 张德政. 基于DeepLab-v3+的遥感影像分类[J]. 激光与光电子学进展, 2019, 56(15):236-243.

[

|

/

| 〈 |

|

〉 |