Journal of Geo-information Science >

Integrating SVM and Graph Matching for Identifying Road Markings from Mobile LiDAR Point Clouds

Received date: 2018-12-28

Request revised date: 2019-03-13

Online published: 2019-07-25

Supported by

National Natural Science Foundation of China, No.41501493

National Natural Science Foundation of Fujian Province, China, No.2017J01465

China Postdoctoral Science Foundation, No.2017M610391

Science Foundation of Education Commission of Fujian Province, China, No.JAT160078

Copyright

This paper presented a novel method for identifying road markings from mobile LiDAR point clouds by integrating Support Vector Machine (SVM) and graph matching. Firstly, the road surface point cloud was extracted using the scanline method, and then, was used to generate independent marking objects by a marking segmentation method combined with intensity correction. Next, hierarchical classification was conducted to identify smaller size markings as the basic objects for further processing. Considering the shape varieties of different types of marking objects, Hu invariant moments, Solid Shape Context (SSC), the area of Minimum Bounding Rectangle (MBR), and extensibility were extracted to construct the marking shape feature vector. Subsequently, with the shape feature vector of the above-mentioned samples, a training sample set was manually established to fit SVM model parameters. In the classification section, the SVM model was conducted for the preliminary classification, where there were situations including cross misclassification of markings with similar shapes and ambiguity between dotted marking and zebra crossing. Building upon the graph structure including certain types of interactive relationship (e.g., arrangement of road markings, direction relationship, and distance between markings in the local area) and the shape feature of markings, we used the inherent characteristics and spatial neighborhood information of objects to synthetically describe the geometric feature and spatial semantic information of road markings. Since the partial absence of markings' semantic structure, we developed an inexact graph matching method based on the graph structure of markings, which could optimize the preliminary classification result. The refined classification results of all six types of road markings included the straight arrow, the crosswalk warning line, the one-way steering arrow, the two-way steering arrow, the dotted marking, and the zebra crossing. To verify the validity of the proposed method, we conducted experiments using four test data sets acquired from different MLS systems. The verification results show that the six marking types have a respective precision of 100%, 100%, 94.12%, 100%, 94.94%, and 99.25%, and a respective recall rate of 100%, 100%, 88.89%, 100%, 98.21%, and 99%, and a respective F1-Measure value of 100%, 100%, 91.43%, 100%, 96.59%, and 99.12%. The experimental results demonstrate that the proposed method could accurately identify multi-class road markings. In conclusion, our algorithm is superior and robust for extracting road markings in even complicated cases where road markings may exhibit significant shape differences or high similarity (e.g., the straight arrow and linear marking, the dotted line and zebra crossing).

FANG Li'na , HUANG Zhiwen , LUO Haifeng , CHEN Chongcheng . Integrating SVM and Graph Matching for Identifying Road Markings from Mobile LiDAR Point Clouds[J]. Journal of Geo-information Science, 2019 , 21(7) : 994 -1008 . DOI: 10.12082/dpxxkx.2019.180697

Fig. 1 Flowchart of the MLS markings classification图1 车载激光点云标线分类流程 |

Fig. 2 SSC structure descriptions图2 SSC结构描述 |

Fig. 3 Cross misclassification between linear markings and straight arrows图3 线状标线与直行箭头交叉错分情况 |

Fig. 4 Graph structure construction diagram(take the straight arrow as an example)图4 图结构构建示意(以直行箭头为例) |

Fig. 5 Graph node matching processes based on BBS algorithm图5 基于BBS算法的图节点匹配过程 |

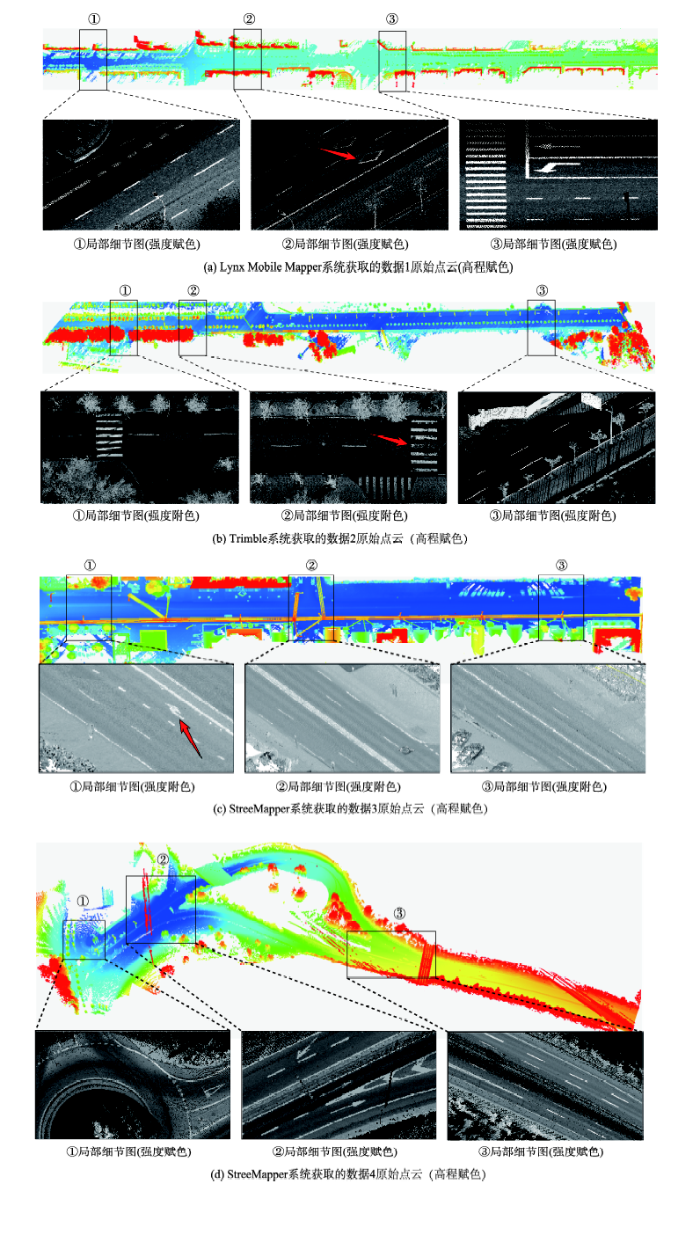

Fig. 6 Overview of the test datasets of four road scenarios图6 4份不同道路场景的实验数据 |

Tab. 1 Manually established training samples(for preliminary classification of markings)表1 人工构建训练样本(用于标线粗分类) |

|

Tab. 2 Training sample set(for preliminary classification of markings) (个)表2 训练样本集(用于标线粗分类) |

| 直行箭头 | 人行横道预告标识线 | 单向转向箭头 | 双向转向箭头 | 线状标线 | 负样本 | |

|---|---|---|---|---|---|---|

| 数量 | 554 | 746 | 770 | 480 | 866 | 560 |

Tab. 3 Matching template samples(for fined classification of markings)表3 匹配模板样本集(用于标线精细分类) |

|

Fig. 7 Segmentation results of target markings (individual objects denoted in different colors)图7 待分类标线对象分割结果(按分割后独立对象赋色) |

Tab. 4 Parameter settings for road markings classification表4 道路标线分类实验参数设置 |

| 参数 | |||||

|---|---|---|---|---|---|

| 参数描述 | 格网宽度/m | 距离上分区数目 | 角度上分区数目 | 参考对象属性权重 | 邻域空间结构权重 |

| 参数值 | 0.02 | 6 | 2 | 1/3 | 2/3 |

Fig. 8 Estimation of the regular grid width about Hu invariant moments图8 Hu不变矩特征相关规则格网宽度估计 |

Fig. 9 Preliminary classification results of road markings based on SVM图9 基于SVM的标线粗分类结果 |

Fig. 10 Refined classification results of road markings based on graph matching图10 基于图匹配的标线精细分类结果 |

Fig. 11 Shaped-smilar road markings misclassification optimization processes based on graph matching图11 基于图匹配的形状相似标线错分情况优化过程 |

Fig. 12 Road markings classification errors of intergrating SVM and graph matching图12 结合SVM和图匹配的标线错误分类结果 |

Tab. 5 Accuracy of road markings' preliminary classification results based on SVM表5 基于SVM的标线粗分类结果精度 |

| 类别 | TP | FP | FN | 精度/% | 召回率/% | F1-Measure/% |

|---|---|---|---|---|---|---|

| 直行箭头 | 11 | 3 | 1 | 84.61 | 91.67 | 87.99 |

| 人行横道预告标识线 | 25 | 0 | 0 | 100 | 100 | 100 |

| 单向转向箭头 | 16 | 1 | 2 | 94.12 | 88.89 | 91.43 |

| 双向转向箭头 | 5 | 0 | 0 | 100 | 100 | 100 |

| 线状标线 | 1053 | 38 | 17 | 96.61 | 98.41 | 97.5 |

Tab. 6 Accuracy of road markings' refined classification results based on graph matching表6 基于图匹配的标线精细分类结果精度 |

| 类别 | TP | FP | FN | 精度/% | 召回率/% | F1-Measure/% |

|---|---|---|---|---|---|---|

| 直行箭头 | 12 | 0 | 0 | 100 | 100 | 100 |

| 人行横道预告标识线 | 25 | 0 | 0 | 100 | 100 | 100 |

| 单向转向箭头 | 16 | 1 | 2 | 94.12 | 88.89 | 91.43 |

| 双向转向箭头 | 5 | 0 | 0 | 100 | 100 | 100 |

| 虚线型标线 | 658 | 35 | 12 | 94.94 | 98.21 | 96.59 |

| 斑马线 | 396 | 3 | 4 | 99.25 | 99 | 99.12 |

Tab. 7 Quantitative evaluation of the markings classification performance of Yu methods and ours表7 Yu方法与本文方法标线分类对比精度 |

| 方法 | 类别 | 精度/ % | 召回率/ % | F1-Measure/% |

|---|---|---|---|---|

| Yu方法[14] | 直行箭头 | 75 | 100 | 85 |

| 人行横道预告标识线 | 100 | 100 | 100 | |

| 单向转向箭头 | 88.89 | 88.89 | 88.89 | |

| 双向转向箭头 | 100 | 100 | 100 | |

| 虚线型标线 | 93.24 | 97.89 | 95.51 | |

| 斑马线 | 99.46 | 92.73 | 95.97 | |

| 本文方法 | 直行箭头 | 100 | 100 | 100 |

| 人行横道预告标识线 | 100 | 100 | 100 | |

| 单向转向箭头 | 94.12 | 88.89 | 91.43 | |

| 双向转向箭头 | 100 | 100 | 100 | |

| 虚线型标线 | 94.94 | 98.21 | 96.59 | |

| 斑马线 | 99.25 | 99.00 | 99.12 |

| [1] |

|

| [2] |

|

| [3] |

|

| [4] |

|

| [5] |

|

| [6] |

|

| [7] |

|

| [8] |

|

| [9] |

|

| [10] |

|

| [11] |

|

| [12] |

|

| [13] |

|

| [14] |

|

| [15] |

|

| [16] |

|

| [17] |

|

| [18] |

|

| [19] |

|

| [20] |

[

|

| [21] |

[

|

| [22] |

[

|

| [23] |

|

| [24] |

[

|

| [25] |

|

| [26] |

|

| [27] |

|

| [28] |

[

|

| [29] |

|

| [30] |

[

|

| [31] |

|

/

| 〈 |

|

〉 |